Diese Frage beschäftigt immer mehr Menschen. Gleichzeitig wird es zunehmend schwieriger, Inhalte, die mit KI erstellt oder manipuliert wurden, von authentischen Inhalten zu unterscheiden.

Viele Plattformen haben die Verantwortung weitgehend an die Community abgegeben. Währenddessen erreichen KI-Influencer Millionen von Followern und emotionalisierte, teils frei erfundene Geschichten verbreiten sich in rasanter Geschwindigkeit.

Kann man das noch unterscheiden?

Kurz gesagt: Ja.

Es gibt Kanäle wie beispielsweise Showtoolsai, die Tools und Techniken vorstellen, mit denen sich KI-generierte Inhalte erkennen lassen.

Die offensichtlichen Fehler früherer Generationen – fehlerhafte Texte, zusätzliche Finger, seltsame Schatten – sind jedoch fast verschwunden. Die Modelle werden kontinuierlich besser. Es ist absehbar, dass wir mit bloßem Auge und selbst mit guter Medienkompetenz zunehmend an unsere Grenzen stoßen.

Die Entwicklungsgeschwindigkeit ist enorm. Schon heute existieren Bilder und Videos, die täuschend echt wirken.

Ist die Lage also aussichtslos?

Nein – und genau hier setzt mein Talk an.

Zahlreiche Unternehmen und Organisationen arbeiten intensiv daran, verlässliche Unterscheidungsmöglichkeiten zu schaffen.

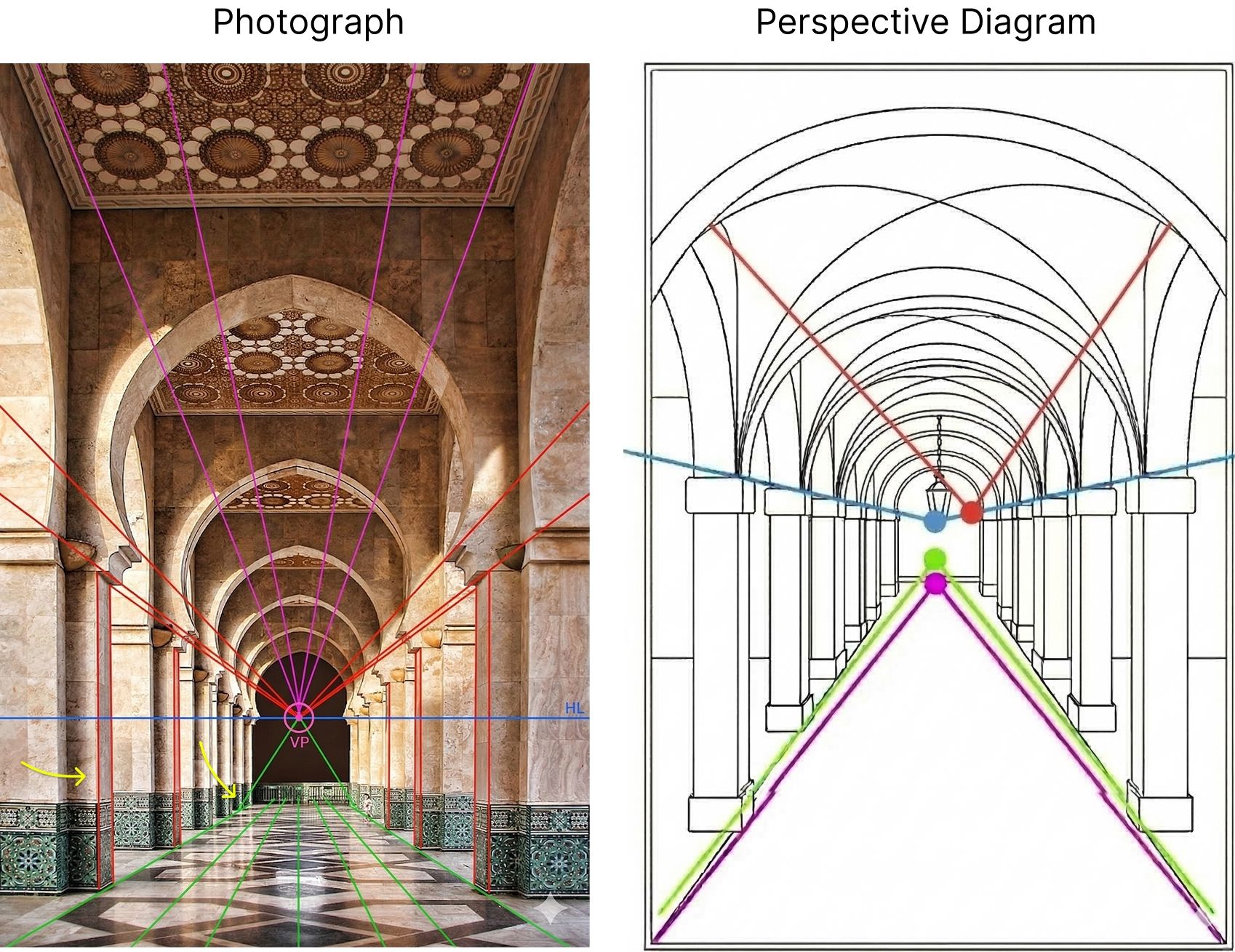

Ein Ansatz kommt aus der digitalen Forensik: Bilder werden auf wiederkehrende Muster, inkonsistente Fluchtpunkte oder andere visuelle Anomalien untersucht, die für das menschliche Auge kaum wahrnehmbar sind.

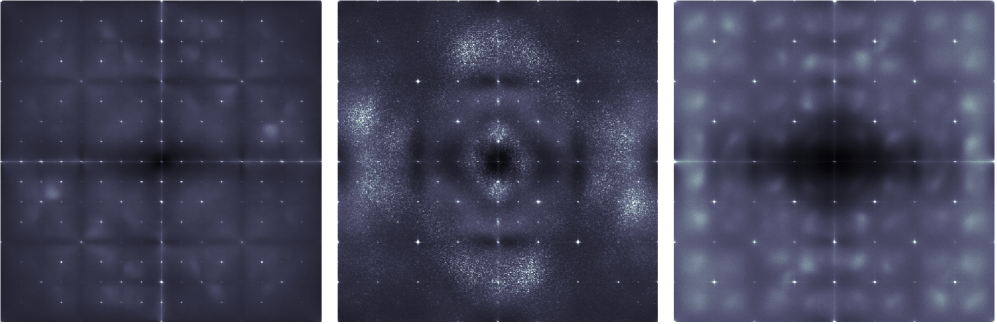

Ein Blick in die Tiefe zeigt, warum das funktioniert: Mithilfe der Fourier-Transformation lassen sich synthetische Bilder analysieren. Dabei werden Muster sichtbar, die für uns verborgen bleiben, aber die Handschrift der jeweiligen KI-Modelle verraten. Es ist wie ein digitaler Fingerabdruck, den die Algorithmen hinterlassen.

Doch nicht nur die Datenstruktur, auch die Logik der Bilder bietet Anhaltspunkte. Aktuelle generative Modelle kämpfen nach wie vor mit den Gesetzen der Perspektive und Geometrie. Während ein echtes Foto einer klaren mathematischen Ordnung folgt, "erfindet" die KI oft eigene Fluchtlinien, die ins Leere laufen oder sich widersprechen. Diese geometrischen Brüche sind ein klarer Beleg dafür, dass das Modell zwar Oberflächen kopiert, aber den dreidimensionalen Raum dahinter noch nicht wirklich versteht.

Ein Experiment verdeutlicht das Problem: Legt man einem KI-Modell ein echtes Foto vor, um die Fluchtlinien analysieren zu lassen, scheitert es oft an der physikalischen Realität. Das Modell zeichnet zwar Linien ein, die optisch „passend“ wirken, aber keinerlei geometrischen Sinn ergeben. Es rät quasi ins Blaue hinein, anstatt die zugrunde liegende Architektur des Bildes zu erfassen. Das zeigt uns: Die KI sieht zwar Pixel, aber sie begreift keinen Raum.

Andere Methoden setzen nicht primär auf das Erkennen von Manipulation, sondern auf den Nachweis von Echtheit. Sie suchen gezielt nach Spuren, die Authentizität belegen. Dieser Ansatz ist robuster gegenüber neuen Modellgenerationen, da er nicht ständig mit neuen KI-Bildern nachtrainiert werden muss.

Unser eigener Ansatz betrachtet Inhalte ganzheitlich: Wir analysieren Kontext, Intention und Wirkung eines Bildes. Ergänzend dazu prüft unser automatischer Faktencheck Autor, Quelle und Verbreitungsumfeld des Inhalts.

Auch große Technologieunternehmen haben die Dringlichkeit erkannt. Sie signieren generierte Inhalte oder entwickeln Standards zur Kennzeichnung, etwa mit SynthID von Google oder durch den branchenweiten Zusammenschluss hinter Content Credentials.

Fazit

Ja, wir erleben aktuell eine massive Welle generierter Inhalte.

Gleichzeitig stehen wir an einem Wendepunkt: Technische Lösungen reifen, Standards entstehen, und immer mehr Plattformen integrieren Mechanismen zur Verifikation.

Die Fähigkeit, Echtheit zu prüfen, wird zur Schlüsselkompetenz. Medienkompetenz ist keine Zusatzqualifikation mehr – sie ist eine Grundlage.

Unternehmen und Startups wie beispielsweise Valid Technologies aus Berlin arbeiten daran, Werkzeuge bereitzustellen, die uns helfen, auch das zu bewerten, was wir nicht unmittelbar sehen oder intuitiv verstehen können.

Die Herausforderung ist real.

Aber auch die Lösungen sind es.